Data in AI-omgevingen heeft niet alleen waakhonden maar ook vangrails nodig

25 maart 2025 12:49

AI revolutioneert bedrijven door taken te automatiseren, inzichten te genereren en de innovatie te versnellen. Naarmate de AI-adoptie versnelt, nemen echter ook de risico's toe die samenhangen met de wijze waarop een AI-toepassing data verwerkt, verplaatst en analyseert. Lees hier waarom voor het gebruik van data voor AI zowel waakhonden als vangrails nodig zijn.

AI-cyberbeveiligingsrisico's

Volgens een recent rapport van McKinsey behoren AI-beveiligingsrisico's momenteel tot de grootste zorgen voor bedrijven van elke omvang. Nu data meer door complexe AI-ecosystemen stroomt, zijn World Backup Day en World Cloud Security Day twee belangrijke momenten voor bedrijven om te heroverwegen hoe ze al hun data beveiligen, beheren en gebruiken.

IT-managers moeten begrijpen dat het beheren en beveiligen van data een holistische aanpak van datamanagement vereist, of dit nu via een moderne data lakehouse-architectuur of een multi-cloud-strategie voor datamanagement is. Naarmate AI dieper in bedrijfsprocessen wordt geïntegreerd, volstaan traditionele methoden van datamanagement niet langer. Organisaties moeten werken aan een continue zichtbaarheid, controle en veerkracht, of het risico lopen hun grip te verliezen naarmate door AI aangestuurde omgevingen steeds complexer worden.

Data is continu in beweging

In tegenstelling tot traditionele datasystemen, waar informatie doorgaans op voorspelbare manieren wordt opgeslagen en geopend, werkt AI op een veel vloeiendere en snellere manier. AI-modellen halen, verwerken en genereren continu data in meerdere omgevingen, uit het eigen netwerk, cloudplatforms en externe AI-services. Met een snelheid en omvang die traditionele securitybenaderingen overtreft. Deze continue beweging van data tussen verschillende teams, afdelingen en systemen maakt het moeilijk om bij te houden waar data vandaan komt, hoe het wordt getransformeerd en wie er toegang toe heeft. Zonder goede beveiliging lopen bedrijven het risico de controle over hun meest waardevolle bezit te verliezen: data.

Veel bedrijven vertrouwen nog steeds op verouderde, reactieve beveiligingsoplossingen, oftewel waakhonden, die pas reageren nadat een bedreiging is gedetecteerd. Het merendeel van de traditionele oplossingen kijkt naar gangbaar en verdacht gedrag. In het geval van AI is wachten tot een probleem zich voordoet geen optie. Bedrijven hebben daarom proactief beschermende vangrails nodig, die ervoor zorgen dat AI-data vanaf de creatie tot en met de archivering worden beschermd, ongeacht waar ze ondertussen naartoe gaan.

AI-uitdaging: meer data, meer risico’s

AI floreert op data en ‘garbage in, is garbage out’. Hoe meer data het tot zijn beschikking heeft, hoe krachtiger en waardevoller de AI-inzichten kunnen worden. Deze toegenomen datastroom introduceert echter ook serieuze beveiligings- en compliance-uitdagingen. Veel bedrijven, of soms zonder dat ze zich ervan bewust zijn de eigen medewerkers, sturen gevoelige data naar AI-modellen zonder een volledig inzicht in waar het naartoe gaat of hoe het wordt gebruikt. Dat creëert uiteraard risico's op onbedoelde blootstelling.

Naarmate de AI-acceptatie groeit, beginnen meer teams binnen de organisatie te vertrouwen op AI-gestuurde inzichten, waardoor data op manieren die moeilijk te volgen en te controleren zijn, door meerdere systemen worden verplaatst. Zonder goed toezicht kan gevoelige informatie, zoals persoonlijke klantgegevens of gevoelige bedrijfsinformatie die is ingebed in AI-modellen of -rapporten, onbewust worden blootgesteld, misbruikt of gedeeld met onbevoegde gebruikers.

Nauwkeurigheid garanderen

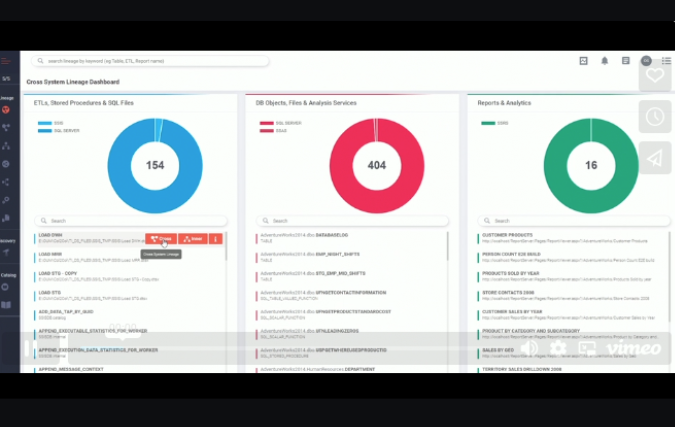

Bovendien kunnen fouten, vooroordelen of verouderde informatie, doordat verschillende teams nieuwe data terugvoeren in AI-modellen, de door AI gegenereerde outputs verstoren, waardoor hun betrouwbaarheid afneemt. Met sterke lineage tracking kunnen bedrijven de nauwkeurigheid van alle data garanderen, om datastromen te traceren en fouten te voorkomen voordat ze invloed hebben op door AI aangestuurde beslissingen. Dat kan onder andere met Octopai van Cloudera, een geautomatiseerde oplossing voor metadatamanagement.

Naast blootstellingsrisico's functioneren veel AI-modellen als black boxes, waardoor bedrijven moeite hebben om te begrijpen hoe al hun data worden verwerkt en getransformeerd. Deze ondoorzichtigheid roept zorgen op over de naleving van regelgeving en kan leiden tot boetes en reputatierisico's als AI-gestuurde beslissingen niet kunnen worden uitgelegd of gerechtvaardigd. Tegelijkertijd blijken traditionele beveiligingsmaatregelen ineffectief in AI-gestuurde omgevingen. AI-modellen zijn dynamisch, leren voortdurend en passen zich aan, wat betekent dat statische beveiligingsoplossingen niet volstaan om deze vloeiende workflows te beschermen.

Richting proactief management

Om AI-data effectief te beveiligen, moeten bedrijven overstappen van reactieve beveiliging naar proactief management. In plaats van snel problemen oplossen na een inbreuk, moeten ze vanaf dag één beveiligingsmaatregelen in AI-workflows inbedden. Dit is zeker nodig in sectoren waar grote hoeveelheden gevoelige data wordt gebruikt, zoals financiële dienstverlening en de zorg.

Toch geeft 60 procent van de organisaties toe niet te weten waar hun kritieke data zich bevindt, volgens het rapport Metadata Management in the Digital Age van Gartner uit 2023.

Onvoldoende inzicht is een serieus probleem: het managen van AI begint namelijk met inzicht en het is van cruciaal belang dat bedrijven begrijpen hoe AI-modellen data verwerken en delen via end-to-end data lineage tracking. Dit zorgt namelijk voor snellere responstijden bij het oplossen van incidenten wanneer er problemen ontstaan.

Governance moet ook worden geautomatiseerd, onder andere door beveiligingscontroles te integreren in AI-workflows. Zo is te waarborgen dat databeveiliging en compliancebeleid data volgen, ongeacht waar deze naartoe gaat, of dit nu on-prem, in de cloud of in AI-ecosystemen van derden is. Het veveiligingsbeleid kan niet statisch blijven, maar moet dynamisch evolueren met AI-gestuurde datastromen. Bedrijven hebben behoefte aan fijnmazige toegangscontroles die, zelfs als ze de innovatiegrenzen verleggen, data alleen toegankelijk maken voor de juiste mensen op het juiste moment, en zich in realtime aanpassen op basis van gebruikspatronen.

Met Shared Data Experience (SDX) van Cloudera kunnen bedrijven zowel een consistente beveiliging als de benodigde governance en naleving implementeren in hun AI-gestuurde datapijplijnen. Zo blijven AI-data beschermd en traceerbaar, van invoer tot inzicht. SDX is een fundamenteel onderdeel van Cloudera’s hybried cloudarchitectuur.

AI-beveiliging is noodzaak

AI-beveiliging is niet langer alleen een IT-uitdaging, maar een bittere noodzaak. Bedrijven die AI-data niet goed beheren, riskeren boetes van toezichthouders, juridische blootstelling en wantrouwen van klanten, wat allemaal vergaande financiële gevolgen kan hebben. Naarmate de acceptatie en adoptie van AI blijft groeien, hebben bedrijven twee keuzes: vertrouwen op verouderde beveiligingsmethoden en snel reageren op bedreigingen en risico’s als deze zich voordoen, of de controle nemen door vanaf het begin sterk AI-databeheer te implementeren.

De toekomst van AI-toepassingen en -beveiliging gaat niet meer over het wachten tot problemen zich voordoen, maar over het voorkomen daarvan voordat ze zich voordoen. Bedrijven die nu al proactieve AI-vangrails inbouwen voor de beveiliging en het beheer van al hun (gevoelige) datatoepassingen, zijn de winnaars van morgen.

Auteur: Rein de Jong, Vice President Benelux bij Cloudera

Reacties op dit artikel

Reactie plaatsen? Log in met uw account.